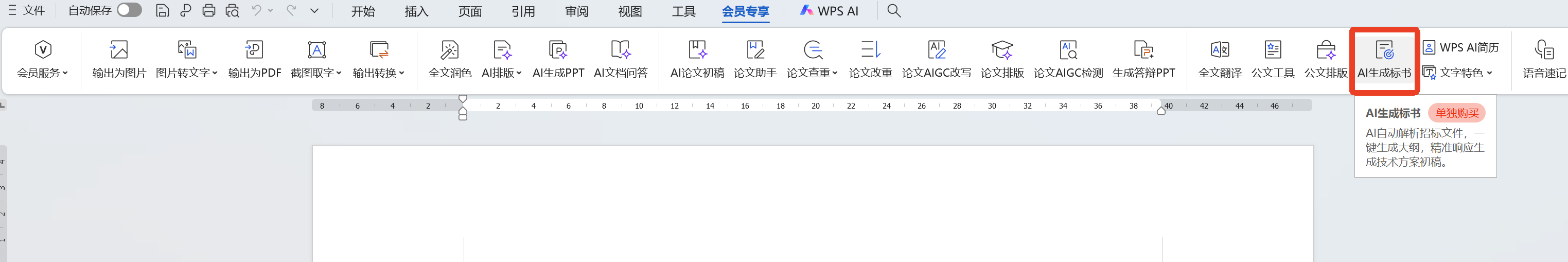

与WPS的合作第10天直接给开了一级菜单

数据出来了,石头落了地

数据出来了,石头落了地

转化率不错,平台直接给开了一级菜单的新入口,这比什么都说明问题

场景就是一切

做AI工具,最要命的就是场景 别总想着搞独立APP,用户的习惯你买不来,流量在哪,战场就在哪 你得扎进用户的文档里,在他最痛苦的时候,把刀递过去 让他跳出自己的工作流来用你的玩意儿,他只会觉得你是个傻逼

数据出来了,石头落了地

数据出来了,石头落了地

转化率不错,平台直接给开了一级菜单的新入口,这比什么都说明问题

做AI工具,最要命的就是场景 别总想着搞独立APP,用户的习惯你买不来,流量在哪,战场就在哪 你得扎进用户的文档里,在他最痛苦的时候,把刀递过去 让他跳出自己的工作流来用你的玩意儿,他只会觉得你是个傻逼

Our ideology can be described by the following guidelines

From Scheifler & Gettys: “X Window System”

目前,大语言模型(LLM)的大规模质量评估方式其实存在根本问题。传统的评估方法,比如 BLEU 和 ROUGE 指标,原本是为了翻译任务设计的,根本不适合处理自由开放、无明确标准答案的生成任务。

人们争相从 AI 工具中榨取最大价值,提示词工程(Prompt Engineering)——也就是编写清晰、结构化的输入来引导 AI 输出的实践——随之站上了舞台中央。但对软件工程师来说,这门手艺不算新。几十年来,我们一直在做类似的事,只是叫法不同罢了。我们今天编写 AI 提示词所面临的挑战,和软件团队几代人以来一直在努力解决的难题,并无二致。今天我们谈论提示词工程,其实只是在延续一个更古老的话题:开发者如何清晰地说明他们需要构建什么、在什么条件下构建、基于什么假设,以及如何将这些信息传达给整个团队。

(Autonomous Legal Risk Officer - Dual-Mode Contract Review Framework)

未来的专业服务,是人与 AI Agent 的协同。这个 prompt,“自主法律风险官 (ALRO)”,就是这种协同的体现。 它的核心是模拟专家思考的双模态决策框架:

可以参考并迁移到Claude Code, Cursor CLI,或其他IDE和CLI 中去,工具不同,场景和解决方案可以学习

引言 应用场景

在 OpenAI,从安全、产品工程、前端、API、基础设施到性能工程,许多技术团队每天都在使用 Codex。大家用它来加速各种工程任务,比如理解复杂系统、重构大型代码库,或是快马加鞭地发布新功能、解决紧急故障。

xiquebiaoshu.com 项目的重要里程碑

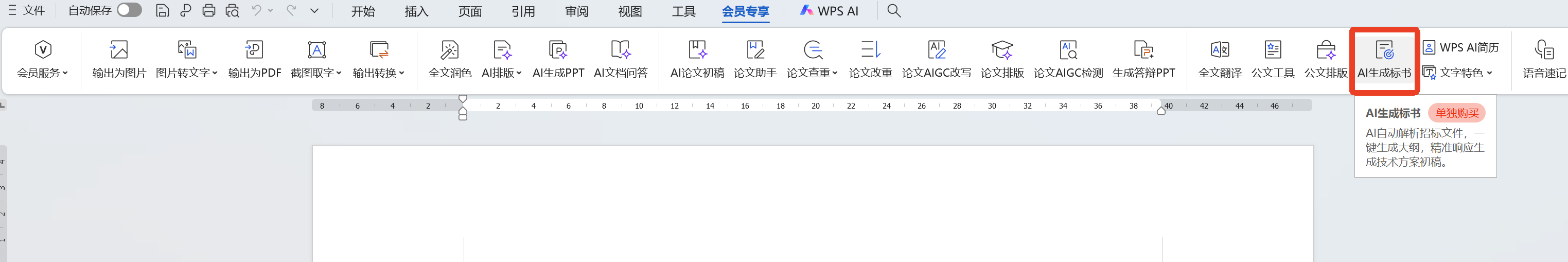

在WPS应用市场和会员专享菜单栏中可以找到 AI生成标书 功能

希望能够在WPS这个大平台继续服务好标书的客户

2024年8月底组建团队启动项目全员封闭在昌平碧水庄园集中开发,到现在整整一年。

前OpenAI核心人物解释LLMs不确定性来源 可复现性,是科学进步的基石。然而,想让大语言模型(LLM)给出可复现的结果,却出奇地难。

举个例子,你可能会发现,多次向 ChatGPT 问同一个问题,会得到不同的答案。这本身不奇怪,因为从语言模型获得结果涉及一个“采样”过程,也就是将模型的输出转换成一个概率分布,然后依概率选择一个词元(token)。

原文:使用大语言模型 (LLMs) 构建产品一年后的经验总结 (第一部分) https://www.oreilly.com/radar/what-we-learned-from-a-year-of-building-with-llms-part-i/ 2025年回头看这篇2024年5月发布的文章,原作者 Eugene Yan, Bryan Bischof, Charles Frye, Hamel Husain, Jason Liu and Shreya Shankar,有些内容已经过时,有些仍有实践价值